Facebook, yapay zekanın hayata birinci şahıs bakış açısıyla bakmasına yardımcı oluyor…

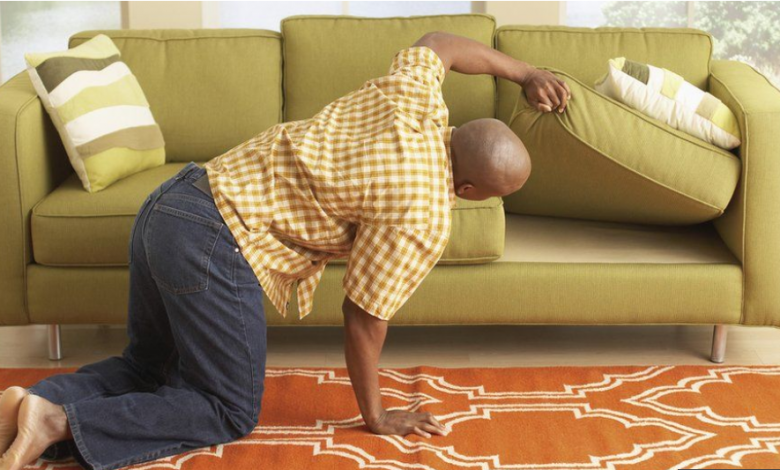

Facebook tarafından yürütülen uzun vadeli bir yapay zeka (AI) araştırma projesi, sonsuz soruyu yanıtlamaya yardımcı olabilir: “O şeyi nereye koydum?”.

Ego4D projesi, yapay zekanın dünyayı “benmerkezci” bir birinci şahıs bakış açısıyla anlamasını geliştirmeyi amaçlıyor.

Umut, artırılmış gerçeklik (AR) gözlükleri gibi cihazların kullanımını iyileştirmektir .

Örneğin, anahtarları nereye koyduğunuzu hatırlamak gibi görevlerde yardımcı olmalarını sağlayabilir.

Bir blog gönderisinde Facebook, “yeni nesil yapay zekanın dünyayı eylemin merkezinden gösteren videolardan öğrenmesi gerekeceğini” savunuyor.

Şirket, dünyayı bu “benmerkezci perspektiften” anlayan yapay zekanın, AR gözlükleri ve sanal gerçeklik (VR) kulaklıkları gibi “sürükleyici cihazların” akıllı telefonlar kadar kullanışlı hale gelmesine yardımcı olabileceğini söylüyor.

Facebook, kulaklık üreticisi Oculus’un mülkiyeti sayesinde VR’ye uzun süredir ilgi duyuyor.

Şirketin son zamanlarda BBC’ye hala geliştirme aşamasında olduklarını söyleyen tam teşekküllü AR gözlüklerini piyasaya sürmesi bekleniyor.https://www.youtube.com/embed/taC2ZKl9IsE?start=4&feature=oembed

Ego4D, kullanıcıların dünyayla birinci şahıs bakış açısıyla etkileşime girmesine yardımcı olan bilgisayarlı görme ve AI sistemlerinin geliştirilmesine yardımcı olmak için “büyük ölçekli benmerkezci bir video veri kümesi” toplamak için ortak bir çabadır .

Proje, dokuz ülkedeki 13 üniversite ve laboratuvardan oluşan bir konsorsiyumu bir araya getiriyor.

Araştırmacılar, veri setinin “855 benzersiz kamera kullanıcısı tarafından yakalanan yüzlerce senaryoyu (ev, dış mekan, işyeri, boş zaman vb.) kapsayan 3.025 saatlik günlük yaşam etkinliği videosunu” içerdiğini söyledi.

Halihazırda bilgisayarla görme algoritmaları, üçüncü şahıs bakış açısıyla yakalanan büyük görüntü ve video veri kümeleri kullanılarak eğitilmektedir.

Facebook’ta araştırma görevlisi olan Kristen Grauman, “Yeni nesil yapay zeka sistemlerinin tamamen farklı bir tür veriden – dünyayı kenardan değil, eylemin merkezinden gösteren videolar – öğrenmesi gerekecek” dedi .

Facebook’un “saatlik görüntü açısından diğerlerinden 20 kat daha büyük” olduğunu iddia ettiği veri kümeleri, Kasım ayından itibaren bir veri kullanım anlaşması imzalayan araştırmacıların kullanımına sunulacak.

Şirket ayrıca daha kullanışlı AI asistanları geliştirmek için beş “kıyaslama zorluğu” geliştirdi. Bunlar, Facebook dedi ki:

- Ne zaman ne oldu? (örneğin: “Anahtarlarımı nerede bıraktım?”)

- Bundan sonra ne yapmam muhtemel? (örneğin: “Bekle, bu tarife zaten tuz ekledin”)

- Ne yapıyorum ben? (örneğin: “Bana davul çalmayı öğret”)

- Kim ne zaman ne dedi? (örneğin: “Ders sırasında ana konu neydi?”)

- Kim kiminle etkileşime giriyor? (örneğin: “Bu gürültülü restoranda benimle konuşan kişiyi daha iyi duymama yardım et”)

Ancak Facebook’un araştırmacılarla bazen gergin bir ilişkisi oldu.

Mahremiyet konusundaki sicili nedeniyle ağır bir şekilde eleştirilen ve para cezasına çarptırılan bir şirketin , hayatımıza bu kadar samimi bir “birinci şahıs” bakış açısıyla teknoloji geliştirmek istediği fikri de bazılarını endişelendirecek.

Yeni Ray-Ban Stories kamera gözlükleri, çok daha sınırlı teknolojiye rağmen gizlilikle ilgili soruları beraberinde getirdi.